��ˮ�߶�Ŀ����ٵĵ�ƥ��ͶƱУ���㷨

���������� ��

(���ϴ�ѧ ��Ϣ��ѧ�빤��ѧԺ������ ��ɳ��410083)

ժ Ҫ��

ժ Ҫ����Թ�ҵ�Ӿ����ϵͳ����ˮ�߶�Ŀ��ʵʱ�������⣬���һ��Ŀ�����ĵ����ƥ�䷽����Ŀ��ͼ��ˮƽͶӰ����ͶƱУ���������ںϵĶ�Ŀ������㷨��������ǣ����ö��Ŀ��������֡ͼ���е�����ֲ����ȶ��Խ�������ƥ�䣬�õ����ƥ���һһӳ���ϵ����Ծֲ�Ŀ��Ļζ����������⣬����Ŀ��ͼ��ˮƽͶӰ���ߣ�����ͶƱУ�����������ֲ��˶�������������ӳ���ϵ����У�������㷨Ӧ����ij�������İ��ļ���ϵͳ����Ч���ų��˸��ӻ����¶�Ŀ�����ʱ����ʶ��©ʶ���λ�ý�������⣬��֤�˼�����ȷ��������ԣ���Ŀ����С��50ʱ������ʱ��С��1 ms��

�ؼ��ʣ�

��ͼ����ţ�TP391 ���ױ�ʶ�룺A ���±�ţ�1672-7207(2007)03-0528-05

Dots matching algorithm based on voting correction for

multi-object tracking on assembly line

LUO San-ding, YANG fang

(School of Information Science and Engineering, Central South University, Changsha 410083, China)

Abstract��For real-time tracking of multi-object on assembly line, a novel algorithm was presented based on fusion of object-center-fast-matching technique and image horizontal projection-curves voting-correction technique. Based on the stability of integral distribution of multi-objects don��t change too much in consecutive frames, this algorithm makes integral matching and obtains the mapping relation for dots matching, and secondly projects image to horizontal axis and uses voting-correction technique to remove errors in mapping relation caused by objects�� local movement. This algorithm was used in a certain steel-bar counting system. The results show that it can solve the problem of misrecognition, un-recognition and position crossing, and tracking time for each frame is less than 1 ms when objects are less than 50.

Key words��multi-object tracking; real-time algorithm; dots matching; correction

����ͼ���Ӿ���������ˮ�߶�Ŀ������Ǽ�����Ӿ�ϵͳӦ���ڹ�ҵ��������һ������ձ���������⣬�����ֳ��İ��ļ�����Ԫ�����������ּ�ȡ�������������������ԣ�������Ŀ��Ϊ�ſ�״���壬Ŀ���С����״����������洫�ʹ����嵥���˶�Ϊ���������ھֲ�����˶���������һ����ֹ����Ŀ����ٵĻ����㷨�У���������ģ��ƥ�䷨�������㷨��ͼ��ָ�ȡ����������ÿһ�����ص���м� ��[1-2]�����Ӷȸߣ�����������ˮ�߸��ٵ�ʵʱ��Ҫ��ģ��ƥ������ȵ�������ͼ����Ϣ����ֻ�ʺ��ڸ�������Ŀ��[2-5]�����ڶ�Ŀ�����ͬ�����ڸ��Ӷȸߵ����⣻�����㷨���м����ٶȿ���ŵ㣬������ȡ�����Ĺ�������ʧ�����õ�ͼ����Ϣ[6]��Ŀ��ֲ��ƶ�ʱ�����¸���ʧ�ܡ�ͼ��ָ�ýϼķ�����ȡĿ���������ֱ�����Ŀ���������Ϣ�������ۺ�����ͼ����Ϣ��������Ϣ����������״��ͬ�����ƵĶ��Ŀ����������[5, 7]�����ڵ�һ�����ľ������Լ�ʵʱ��Ҫ����Ҫ���ö༼���ںϵķ���[8-9]�������ˮ�߶�Ŀ����ٵ����⣬�����������Ŀ�����ĵ����ƥ�似����Ŀ��ͼ��ˮƽͶӰ����ͶƱУ���������ںϵĶ�Ŀ����ٷ���������������Ŀ������ֲ��������п��ٶ�λ�õ���ʼ�����������Ŀ��ͼ��ˮƽͶӰ���߶Գ�ʼ�������ͶƱУ���õ����ս����

1 �����ںϿ��

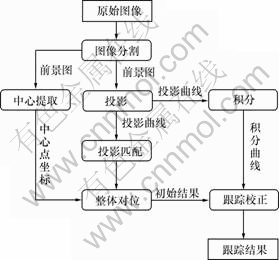

�����ںϹ�����ͼ1��ʾ�����ȣ�ԭʼͼ��ͼ��ָ����õ�Ŀ��ǰ��ͼ����Σ���ǰ��ͼ�ֱ������ȡĿ�����ĺ�ˮƽͶӰ�õ�ͶӰ����2�ִ����������ͶӰ����Ҳ�ֱ���� 2 �ִ�����һ�ǽ���ͶӰƥ��õ�����ƫ���������ǽ��л��ֵõ��������ߣ��ٴΣ���������ƫ����ȷ��Ŀ�����ĵ�ƫ��ֵ��ʵ�������λ������û������߶������λ�������У�����õ����ո��ٽ����

ͼ1 �༼���ںϵ�������ͼ

Fig.1 Data flow graph of multi-technique fusion

Ϊ�˱�����������CF��ʾ��ǰ֡��Ŀ��������ȡͼ��PF��ʾǰһ֡��Ŀ��������ȡͼ�����ﶨ��1��ֱ������ϵ������ԭ����CF��PF�����½ǣ�x��ˮƽ���ң� y�ᴹֱx�����ϡ�

2 ��λ��У��

2.1 �����λ

���Ŀ���洫�ʹ���ǰ�ƶ�ʱ������ֲ�����һ����״̬���������ֲ����䣬�������Ŀ��ͼ��ˮƽͶӰ���߽���ƥ���������ƫ������ʵ��ǰ����2��ͼ����Ŀ��Ŀ��ٶ�λ��

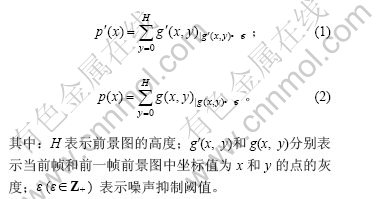

2.1.1 ͶӰ

��p��(x)��p(x)�ֱ�Ϊ��ǰ֡��ǰһ֡Ŀ��ͼ���ˮƽͶӰ���ߣ����߶������£�

2.1.2 ����ƫ��������

Ŀ��������x���ϵĵ����˶����ʿɲ���ģ��ƥ�似����p��(x)��p(x)����ƥ�䣬ͨ������õ�����ƫ����[10]��

2.1.3 ����ƥ��

��������ֲ����䣬��CF�е�Ŀ��A��PF�е�Ŀ��B���ߵ�y����ֵ�������A��x����ֵ������ƫ��������B��x����ֵ���������ΪA��BΪͬһ��Ŀ�ꡣ

����1���������λ���ΪS������ÿһ��ƥ���ΪS�е�1��Ԫ�ء�

2.2 ͶƱУ��

���ڴ���Ŀ��ľֲ�λ�ƣ�S�д��ڲ��ִ���Ϊ�������ִ���ͬʱ����ʵʱ��Ҫ����ͼ��ˮƽͶӰ���ߵ�ͶƱУ���������ж�λУ������ͨ����ͼ���ˮƽͶӰ���߽��л��ֵõ��������ߣ���ͨ������������S�е���֪ƥ����Ƶ�����ƥ��Բ�����ͶƱ��S������Ԫ�ؾ�ͶƱ�����ÿ����ͶƱ��ƥ�������Ʊ������Ʊ������������ֵ������Ϊ��ƥ�����ȷ���������

2.2.1��ͶӰͶƱ�㷨

��ͶӰ����p��(x)��p(x)��x����л��ֵõ���������c��(x)��c(x)��

����������£�2��ƥ���֮����ǰ��֡������Ŀ������ͬ��������֮����ǰ��֡�е�ͶӰֵ���ۼ�ֵ��ͬ�����������߲�ֵ��ͬ����ˣ�����֪1��ƥ��ԣ�����ɻ��������Ƶ�����������ƥ��ԡ������ڹ��ղ�����ijЩĿ����ǰ��2֡ͶӰֵ�仯�ϴ���ɻ������ߵ�����ۻ�����Խ�������Խ��Ϊ�˱�������ۻ��������ɵ�ǰƥ����Ƶ��ڽ���ƥ��Բ������Ƶ���ͶƱ������

a. ͶƱ������2֡������2��Ŀ��֮���ͶӰ����ֵ�仯��С���ʿ���S�еĵ�����֪Ԫ��a�Ƶ����������ڵ�ƥ��ԣ��������ڵ�ƥ����Ƶ�����һ������ƥ��ԣ����ε��ƣ�ֱ����������ƥ���Ϊֹ������ͶƱ�����������£���֪CF�е�i��Ŀ����PF�е�j��Ŀ����ƥ�䡣��X��(i)��ʾCF�е�i��Ŀ�����ĵ�x����ֵ��X(i)��ʾPF�еĵ�j��Ŀ���x����ֵ����PF�е�j-1��Ŀ���x����ֵΪ��

![]()

��Щ�Ƶ�������ƥ���Ϊa��ͶƱ���ƴ˹���Ϊa��ͶƱ���̡���S�е�ÿ��Ԫ�ؾ�����ͶƱ���㣬��õ�һϵ��ƥ��ԣ���Ϊ��ͶƱ�����

b. ����������S�е�ƥ�������ɿ��Բ��ߣ�����Ԫ�ر���Ϊ��ʱ�����Ƶ�����ƥ��Ծ�������֮���ԡ�����Ҫ�Գ�ͶƱ����е�ƥ��Խ��пɿ��Կ��죬��ȷ�����Ƿ�Ϊ��ȷƥ��ԡ�

��m��ʾS��Ԫ�ظ���������S�е�ÿһ��Ԫ�����Ŷ��в��죬����V(i)(i=0������m)��ʾ�����Ŷȡ�Ԫ��ͶƱ���������Ŷ��ۼӵ�ͶƱ�����Ʊ���ϡ���V(i)��Ϊ1ʱ����m��ƥ����а��������ǶԵģ����ͶƱ�����Ʊ�������ƥ���Ϊ��ȷ��ƥ��ԣ�����Ϊ�����ƥ��ԡ�����������S�а��������ǶԵ���������ʱ������������£�����ģ��ƥ���Ŀ�����λ�ù�ϵ���ķ������S������Ԫ�ص���ȷ�ԣ�����ȷ������ЩԪ�ص����Ŷ���ߣ�����ͽ��ͣ�����ʹ����ȷƥ��Ե����Ŷ��ܺʹ��ڴ���ƥ��Ե����Ŷ��ܺ͡�����������ͶӰͶƱ�㷨��Ȼ�õ���ȷ�ĸ��ٽ����

2.2.2 ͶӰͶƱ�㷨�Ż�

��S��ijһԪ�ؿ��Ƶ�����һԪ��ʱ��2��Ԫ�ص�ͶƱ�����ͬ���ʿɲ���ÿ����һͶƱ��ֻ�轫����ͶƱ����е�ÿһͶƱ�����Ʊ��������Ԫ�ص����Ŷȼ��ɡ��ݴˣ��ɶԿ���ͶӰͶƱ�㷨�����Ż����Ż������������£�

// ����S�е�ÿһԪ��

// ����ͶƱ���

// �����Ŷ��ۼ�

If Ԫ���Ѿ�����

// �ۼ�ÿ����������Ŷ�

Else

// ��Ԫ��ͶƱ

// �ۼ�ÿ����������Ŷ�

����2�������S�е�ijһԪ��aͨ��ͶӰͶƱ�����Եó�S�е�����1����һЩԪ�أ����a����ЩԪ������ͬһ�ࡣ

��n��ʾ��CF����ʶ�������Ŀ������w��ʾS�е�����Ŀ��Ck (k=1������w)��ʾ��k���ࡣ��ÿ����Ck����rk��Ԫ�أ���ЩԪ�ص�ͶӰͶƱ�����ͬ����ΪAk��������Ak��Ѱ��ijһƥ��������ƽ��ʱ��Ϊt����ijһ��֪ƥ����Ƴ�����ijһƥ�������IJ���ʱ��Ϊt0����ͶӰͶƱ�㷨����IJ���ʱ��Ϊm(n-1)t0�����ÿ����㷨����IJ���ʱ��Ϊ��

![]()

����t0Զ����t���ʿ����㷨�IJ���ʱ�����Ϊw(n-1)t0�����ԣ�2���㷨��ʱ���Ϊ(m-w)(n-1)t0����һ������£�wС��5����1֡�����������С����ԭʼ�����m��Խϴ�

2.2.3 ��һ��У��

��������ȡ�����У�ͨ����������2�ִ�����ʶ���©ʶ����У������Ļ����ϣ�ͨ���ڽ�ƥ�䷨����©ʶ�����ʶ��Ŀ���ڶ�Ӧ֡�п��ܴ��ڵ�λ�ã��ɸ�����2�ִ���2������Ŀ��λ����ǰ��֡�з���λ�ý���ʱ���ɵ���ͶӰͶƱ�����ٴ�������ƥ�䷨���õ��ڽ�ƥ�䷨�пɱ��⽻������Ӱ�죬�ػ���ȷ�����

3 ʵ��

���ォ���㷨���ڽ�������������еĸ������⡣���ʹ����ڶ���Ľ������в����ڶѵ�����[11]�����а��ĵĶ��涼������Բ��[12]�����ھֲ��ζ�������������

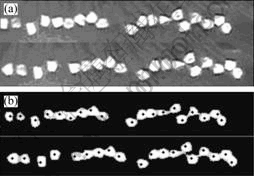

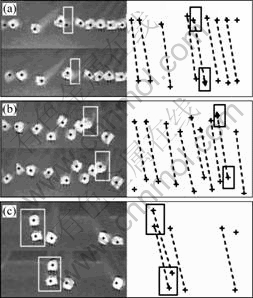

ͼ2(a)��ʾΪ��ǰ֡��ǰһ֡��ԭʼͼ��ͼ2(b)��ʾ��2(a)����ɫ�ָ[13]��õ���ǰ��ͼ���Լ����ñ�Ե�����㷨�ͻ�ƥ���㷨[12]���õ�Ŀ������ʶ������ǰ��ͼ��ͶӰ��������������ͼ3��ʾ��

(a) ԭͼ; (b) ǰ���ָ�ͼ������ʶ����

ͼ(a)��(b)�У��ϲ��ʾ��ǰ֡ͼ���²��ʾǰһ֡ͼ��

ͼ2 ԭʼͼ����ǰ���ָ�ͼ

Fig.2 Initial image and segmented image of foreground

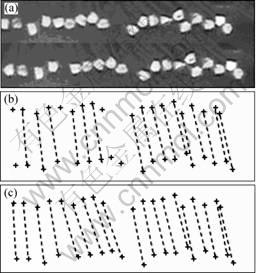

(a) ��ǰ֡ͶӰ����; (b) ǰһ֡ͶӰ����;

(c) ��ǰ֡��������; (d) ǰһ֡��������

ͼ3 �Ҷ�ͼ��2������

Fig.3 Two curves of gray-level image

ͼ4(a)��ʾΪ��ǰ֡��ǰһ֡��ԭʼͼ��ͼ4(b)��ʾΪ�����λ��������Կ��������ƥ�������ȷ

�ģ������ھֲ��ζ���ʹ�������λ�������������CF�еĵ�6������ƥ����PF�еĵ�5�����ģ���ȷ��Ϊ81%���ڱ�ʵ���У�V(i) ȡΪ1��ͼ4(c)��ʾΪ��ͶӰͶƱ�㷨���ý����ȫ��ƥ����ȷ��

(a) ԭͼ���ϲ��ʾ��ǰ֡ͼ���²��ʾǰһ֡ͼ��;(b) �����λ���; (c) ͶӰͶƱ���

ͼ4 �����λ��ͶӰͶƱ�㷨�ĸ��ٽ��

Fig.4 Tracking results of integral matching and projection-voting algorithm

ͼ5��ʾ����ʶ��©ʶ���λ�ý���3������¸��㷨�ĸ��ٽ����ͼ���þ��ο�ָ������3������ľ���λ�á����У���ͼ��ʾԭʼͼƬ�����Ķ�������ʶ��������ͼ��ʾ���ٽ�������ο��ڼ�ͷ��ʾ����λ�á����ø��ٽ��������K���ݴ�������[10]�����ɵõ�ȷ�ļ��������

(a) ��ʶ��(b) ©ʶ��(b) λ�ý���

ͼ5 3������µİ��ķֲ������ٽ��

Fig.5 Images of tracking results in three cases

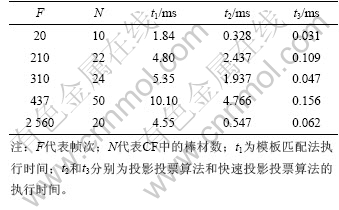

��1��ʾΪģ��ƥ�䷨��ͶӰͶƱ�㷨�Ϳ���ͶӰͶƱ�㷨3���㷨��ִ��ʱ��ȽϽ�������У�ģ��ƥ�䷨�ǽ�CF��ÿһ��Ŀ�����ĵ�ͨ������ƫ������PF��Ѱ�Ҷ�Ӧ�����ĵ㣬Ȼ���ô�ͳģ��ƥ������[3]����R��R(RΪ���Ķ���ֱ��)����ͨ��ģ���ڶ�Ӧ���ĵ㼰���ڽ�2���4��4�������ƥ�䡣���ԣ��㷨��ִ��ʱ��Ϊ48tp(����tpΪ����ģ��ƥ��ʱ��)����t0Ϊֻ��1�ο���������1�μӼ���������ʱ�䣬���ԣ�tpԶ����t0����mͨ��С��48����ͶӰͶƱ�㷨�ٶȱ�ģ��ƥ���㷨�ٶȿ졣

��1 ģ��ƥ�䷨��ͶӰͶƱ�㷨�Ϳ���ͶӰͶƱ�㷨��ִ��ʱ��

Table 1 Execution time of template matching algorithm, projection voting algorithm and its optimized algorithm

�ӱ�1���Կ�����ͶӰͶƱ�㷨��ִ��ʱ��ԶС��ģ��ƥ���㷨ִ��ʱ�䣻ͶӰͶƱ�㷨���Ż�����ijЩ֡���±��Ż�ǰ��10������ʱ�䲨���Ƚ�С����˵�����ĸ��Ӷȵ͡�

4 �ᡡ��

a. ������ķ���³����ǿ�����Խ����Ŀ������е���ʶ��©ʶ���λ�ý�������⡣��Ŀ����С��50�ĵ�֡ͼ��ĸ����У����������λ��ʱ��С��0.8 ms��ͶƱУ��ʱ��С��0.2 ms���ʸ��㷨��ִ��ʱ��С��1 ms������Ŀ������ʶ��Ļ����ϣ�ֻ���˺��ٵ�ʱ�����ڸ��١���ʹ�ø÷�����Ӧ������ˮ�ߵ�ʵʱ��Ŀ����١�

b. ��Ŀ��ѵ���������3��ʱ�� Ŀ��ͼ���ˮƽͶӰ���߲���ȷ��ӳ����Ŀ���ˮƽ����λ�ã��ʽ���ͶƱУ��ʱ���׳������������д��ڽ�һ���о���

�ο����ף�

[1] ���̵�, ������. ������Ӿ�[M]. ����: ��ѧ������, 1998.

MA Song-de, ZHANG Zheng-you. Computer vision[M]. Beijing: Science Press, 1998.

[2] ��ӧ, ������, ¬����. �˶�Ŀ�����㷨��̽��[J]. ���������, 2006, 23(10): 222-223.

WANG Ying, HAN Yi, LU Han-qing. The methods for moving object detection[J]. Computer Simulation, 2006, 23(10): 222-223.

[3] �� ��, ������, ���˼�, ��. ����ͼ����[M]. ����: �����ʵ������, 20001.

HE Bin, MA Tian-yu, WANG Yun-jian, et al. Digital image processing[M]. Beijing: Peoples�� Posts & Telecommunications Press, 2001.

[4] Betke M, Haritaoglu E, Larry S D. Real-time multiple vehicle detection and tracking from a moving vehicle[J]. Machine Vision and Applications, 2000, 12(2): 69-83.

[5] Xu L Q, Landabaso J L, Lei B. Segmentation and tracking of multiple moving objects for intelligent video analysis[J]. BT Technology Journal, 2004, 22(3): 142-147.

[6] Chetverikov D, Verestoy J. Feature point tracking for incomplete trajectories[J]. Computing, 1999, 62(4): 321-338.

[7] Chantelau K. Segmentation of moving images by the human visual system[J]. Biological Cybernetics, 1997, 77(2): 91-100.

[8] ������, �� ��, ̷ ��. �������Ӿ��ŷ��о���չ[J]. ������, 2004, 26(3): 279.

WANG Lin-kun, XU De, TAN Min. Survey of research on robotic visual serving[J]. Robot, 2004, 26(3): 279.

[9] ������, Ѧģ��, ��ԣ��, ��. ��������������ҶȽ�����ص�����ͼ��ƴ��[J]. �����뼤���, 2005, 34(5): 602-603.

LENG Xiao-yan, XUE Mo-gen, HAN Yu-sheng, et al. Sequence image swtitching based on area feature and cross correlation[J]. Infrared and Laser Engineering, 2005, 34(5): 602-603.

[10] ������, ���ƽ. K���ݴ������㷨�������ʵ��[J]. �����������Ӧ��, 2004, 40(16): 94-95.

LUO San-ding, LI Di-ping. Design and implementation of K-time-count fault tolerance algorithm[J]. Computer Engineering and Application, 2004, 40(16): 94-95.

[11] ������, ɳ ɯ, ���ҫ, ��. �������������Ӿ�����ϵͳ�о�[J]. С���ͼ����ϵͳ, 2004(4): 672-673.

LUO San-ding, SHA Sha, SHEN De-yao, et al. On-line visual counting system for production of steel bar[J]. Minimicro Systems, 2004(4): 672-673.

[12] ������, Ф ��. ��������Բ���ſ�Ŀ��ͼ��ʶ����·���[J]. ���ϴ�ѧѧ��: ��Ȼ��ѧ��, 2004, 35(8): 633-636.

LUO San-ding, XIAO Fei. A new method of recognizing quasi-circular object[J]. Journal of Central South University: Science and Technology, 2004, 35(4): 633-636.

[13] �ֿ���, �����, ������. ��ɫͼ��ָ������[J]. �й�ͼ��ͼ��ѧ��, 2005, 10(1): 2.

LIN Kai-yan, WU Jun-hui, XU Li-hong. A survey on color image segmentation techniques[J]. Journal of Image and Graphics, 2005, 10(1): 2.

�ո����ڣ�2006-12-11

������Ŀ��������Ȼ��ѧ����������Ŀ(60573079)

����飺������(1955-)���У���������ˣ����ڣ�����ͼ������������Ϣ�����о�

ͨѶ���ߣ��� ����Ů��˶ʿ�о������绰��0731-8830982��E-mail: onlysfang@hotmail.com

[1] ���̵�, ������. ������Ӿ�[M]. ����: ��ѧ������, 1998.

[2] ��ӧ, ������, ¬����. �˶�Ŀ�����㷨��̽��[J]. ���������, 2006, 23(10): 222-223.

[3] �� ��, ������, ���˼�, ��. ����ͼ����[M]. ����: �����ʵ������, 20001.

[8] ������, �� ��, ̷ ��. �������Ӿ��ŷ��о���չ[J]. ������, 2004, 26(3): 279.

[9] ������, Ѧģ��, ��ԣ��, ��. ��������������ҶȽ�����ص�����ͼ��ƴ��[J]. �����뼤���, 2005, 34(5): 602-603.

[10] ������, ���ƽ. K���ݴ������㷨�������ʵ��[J]. �����������Ӧ��, 2004, 40(16): 94-95.

[11] ������, ɳ ɯ, ���ҫ, ��. �������������Ӿ�����ϵͳ�о�[J]. С���ͼ����ϵͳ, 2004(4): 672-673.

[12] ������, Ф ��. ��������Բ���ſ�Ŀ��ͼ��ʶ����·���[J]. ���ϴ�ѧѧ��: ��Ȼ��ѧ��, 2004, 35(8): 633-636.

[13] �ֿ���, �����, ������. ��ɫͼ��ָ������[J]. �й�ͼ��ͼ��ѧ��, 2005, 10(1): 2.