һ�ֻ��ڸĽ���ֵƯ�Ƶ�ʵʱĿ����������㷨

��ӱ�ݣ��ž꣬���ļ�

(����������ѧ �Զ���ѧԺ������������ϵͳ���ܿ���������ص�ʵ���ң�������100081)

ժ Ҫ��

ͳ�µ��˶�ǰ��Ŀ�꣬���һ�ָĽ���ʵʱĿ��������ٷ��������ȣ����˶�Ŀ����ν�����Ƶ����ʱ��ͨ����������Ӧ��ϸ�˹ģ�͵ķ�����ȡ�˶�Ŀ�ꡣȻ�������ں��˿������˲��ľ�ֵƯ���㷨���˶�Ŀ�����Ԥ����٣�ʹ���ܴ����涯ϵͳ����Ұ���ġ�������㷨�ȱ�֤�˼����ٵ�ʵʱ�ԣ��������˶��˶�Ŀ����и��ٵ���Ұ��Χ��ʵ�������������㷨�ܹ�ʵʱ�Զ��ض��˶�Ŀ����м�����涯���١�

�ؼ��ʣ�

�������˲�����ֵƯ����Ŀ������Ŀ�������

��ͼ����ţ�TP301 ���ױ�־�룺A ���±�ţ�1672-7207(2011)S1-0823-06

Real-time moving object detection and tracking based on improved mean shift

LEI Ying-hui, ZHANG Juan, YANG Wen-jia

(Key Laboratory of Complex System Intelligent Control and Decision, Ministry of Education,

School of Automation, Beijing Institute of Technology, Beijing 100081, China)

Abstract: An improved real-time target detection and tracking method was proposed based on moving foreground object in the servo monitoring system. This method extracts moving object based on adaptive mixture of Gaussian when the object comes into the video scene, then tracks the moving object using improved MeanShift algorithm, and makes it in the center of the scene. The algorithm not only ensures the real-timing of the detection and tracking, but also enlarges the sight of the camera when the object is tracked. The experiment results show that this method can automatically detect moving object and do servo tracking.

Key words: Kalman filter; mean shift; moving foreground segmentation; moving object tracking

�ڼ�����Ӿ��о������У�ּ�ڸ�����ϵͳ�۲������������������������Ƶ��ؼ����ǽ��������ܹ�ע��ǰ�ط�����Ϊʵ�ּ�ص��Զ��������ܻ����о��Ӧ��DZ��[1]���˶�Ŀ��ļ����������ܼ��ϵͳ����Ҫ�о����ݣ��������߲㴦����Ŀ�������ʶ����Ϊ���⼰���������ȵĻ�����

���������ֹ������±���ģ����֪��Ŀ����Ƚ����ף�Ŀǰ��Ҫ�ķ����б�����������[2]��֡����[3]��������[4]�ȡ���������˶�ʱ�����ڱ���Ҳ���˶�����ͳ�ľ�ֹ����ͼ�������µ�Ŀ���⼼����Ӧ��, ʹ���˶�Ŀ���������ø�����ս�ԡ�Ŀǰ��ѧ�����������������µļ�ⷽ���Ļ���˼����[5]������ȫ���˶��������ƺͱ�����������������ת��Ϊ��ֹ������µ�Ŀ�������⡣����Щ�����������ھ�ȷ���˶�ģ�ͺͷ���ģ�ͣ��ڷDZ궨ϵͳ������Ӧ�ã�������������Ӧ����ʵʱ�ļ��ϵͳ�С�

�˶�Ŀ������㷨�г��õ��п������˲�����ֵƯ���㷨�Լ������˲��ȡ����о�ֵƯ���㷨[6]��һ�ֻ��ں˺����ܶ������ӵ��������Ʒ�����������������֪ʶ�������ٶȿ���ŵ�õ��˹㷺��Ӧ�á�������ijЩ�����´���һЩ���㣬�������Ŀ������������֡��ƫ�ƽϴ�����ٽ����������ƫ���������ʧ�ܣ��ҶԸ��ӱ����µĻҶȳ����˶�Ŀ��ĸ�������Ҳ��Ҫ��ߡ�

��������涯���ϵͳ�µ��˶�ǰ��Ŀ�꣬�����һ��ʵʱ�������ٵķ�����

1 �������

1.1 ϵͳ����

�豸ʾ��ͼ��ͼ1��ʾ���߾�����̨װ�����ż��ϣ�����װ���о�ͷ������CCD�����������̨ͨ�������ߺ�PC������������CCD���������PC��ͨ��1394ת�ӿ�ʵ��ͨ�š�ϵͳ��Ҫ����������ɼ�����ͼ���е��˶�Ŀ��������������١�

ͼ1 �豸ʾ��ͼ

Fig.1 Equipment schematic diagram

1.2 �������

�ڴ�ͳ����Ƶ���ϵͳ�У������ͨ���Ǿ�ֹ�ģ��������������һ���Ƕ��ڵĹ۲췶Χ���ޡ���ʵ��Ӧ���У�Ϊ��ȷ���Կ���Ŀ����߸���ȤĿ��Ĵ���Ұ�����ĸ��٣��ڲ���������ͷ��ǰ���ϣ���������������涯�����ǺܺõĽ���ֶΡ�Ȼ����Ŀǰ������˶�����µ�Ŀ�����㷨����������⣬������������Ӧ����ʵʱϵͳ��������������¼�������ѵȡ�

Ϊ�ˣ����Ĺ��������·�����ܣ�����ʱ��ϵͳ���ȴ��ڼ��״̬����������ɼ�ͼ�����PC�����Գ��ֵ��˶�Ŀ����м�⣬��Ŀ����ȫ���볡����������ģ�飬PC��ͨ������Ŀ��λ������Ұ���ĵ�����źſ��Ƹ߾�����̨ת�������������������������̨ת����ͬʱ����ͼ��ɼ����ɼ�����ͼ�����������涯���١�

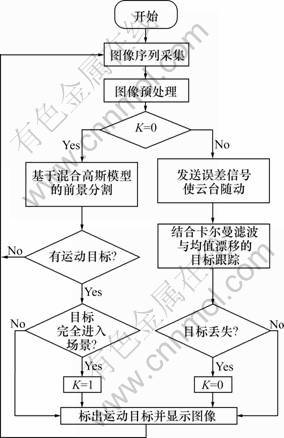

ϵͳ�����㷨����ͼ��ͼ2��ʾ�����У�KΪ������ģ��ı�ʶ��K=0ʱϵͳΪʵʱ���״̬��K=1ʱϵͳΪ�涯����״̬��

ͼ2 ���������㷨����ͼ

Fig.2 Flowchart of detection and tracking algorithm

ǰ���ָ��Ƕ�Ŀ�����ʶ������ٵĻ������ָ���������ֱ��Ӱ���Ժ�����Ч��������������ֹ����µĸ��ӱ�����ѡ���Ի�ϸ�˹����ģ��Ϊ���������˶�Ŀ����м�Ⲣ��ȡĿ����������Ŀ���ȶ���ϵͳ�������ģ�顣

�ڸ���ģ���У�����ʱ�̴�������Ķ�̬�仯֮�У��˶�Ŀ����ܻᷢ����̬�仯���߶ȱ仯�����Ź��߱仯����������ɫ�仯�ȣ�����Ŀ��ܿ��ܻ�����������������ɫ��������״����ĸ��ţ����Ƕ�ʵʱ�ȶ��ظ����˶�Ŀ������˾����ս��������Ծ�ֵƯ���㷨�IJ��㣬�����˽�Ͽ������˲��ľ�ֵƯ���㷨���ƶ�Ŀ����и��١�

2 �˶�Ŀ����

�˶�Ŀ������ǵ�����������Ŀ�������߳�������Ŀ���ƶ�ʱ��ͨ���㷨�����˶�Ŀ�꣬������Ŀ��ָ�ķ����ѽ��볡���е��˶�Ŀ��(ǰ��)�ӱ� ��ͼ���з��������Ȼ���ж�����ʵ�ԣ��Ǹ��١�ʶ��Ⱥ��������Ļ����Թ�����

���IJ�����Stauffer��[7]���������Ӧ��ϸ�˹ģ�ͶԱ������н�ģ�������˶�Ŀ��ļ�⡣�����2���������������

2.1 ���ڻ�ϸ�˹ģ�͵ı�����ģ

��ϸ�˹ģ�͵Ļ���˼��[7]�ǣ���ÿһ�����ص㣬����K����˹ģ�ͱ�ʾ�����ص���ij��ʱ���ڲ�ͬ��״̬�����ǵ��㷨���ٶ��Լ��㷨��Ч�ԣ�Kֵһ��ȡ��3��5֮�䡣K��״̬��һ���ֱ�ʾ���ص�Ϊ����ʱ��״̬�����ಿ�����ʾ���ص�Ϊǰ��ʱ��״̬������XtΪ���ص���ʱ��t����ɫֵ��������ʺ����ɱ�ʾΪ��

![]() (1)

(1)

���У�![]() Ϊtʱ�̵ĵ�i����˹�ֲ��ĸ����ܶȺ��������ֵΪ��i,t��Э�������Ϊ��i,t����i,tΪ��i����˹�ֲ���tʱ�̵�Ȩ�أ�����

Ϊtʱ�̵ĵ�i����˹�ֲ��ĸ����ܶȺ��������ֵΪ��i,t��Э�������Ϊ��i,t����i,tΪ��i����˹�ֲ���tʱ�̵�Ȩ�أ�����![]() ��

��

��ʼ����ϸ�˹ģ�ͣ�����ͨ������һ��û��ǰ���˶��������Ƶ����ͼ���е����ؾ�ֵ�ͷ������õ������ǵ���ʵ�����������Ȼ�ȡ��֡����ͼ��Ŀ����Բ����ټ��ϱ����Ķ���ԣ��÷�����³���Բ����ߡ�

������Ϊ��һ֡��Ƶͼ��Ϊ���������Ŀ����Խϴ�ʹ��һ֡ͼ�����˶�Ŀ�꣬���������ͼ����˵���˶�Ŀ������Ҳֻռ��С��һ���֣�ȡ��һ֡ͼ�������ֵ��Ϊ��ϸ�˹ģ����ij����˹�ֲ��ij�ʼ��ֵ�����Ըø�˹�ֲ���Ȩֵȡ��Խϴ�ֵ��ȡ������˹�ֲ��ľ�ֵΪ�㣬Ȩ����ȡ���ϸ�˹ģ�������и�˹�����ķ���ȡ��Ⱦ���ֵ��

���õ��µ���Ƶ֡ͼ������µ�����ֵ�ѻ�ϸ�˹ģ�͵����в������£�Ȼ������и�˹������Ȩֵ��һ�������Ѹ�����˹�ֲ���Ȩֵ�Ӵ�С���С��ֲ�λ��Խ��ǰ�����DZ����ֲ��Ŀ�����Խ�������DZ����ֲ��Ŀ�����ԽС���������ĸ�˹�ֲ����ᱻ�½����ķֲ���ȡ����ʵ��������ڲ�����ʼ��ʱ�����˶�Ŀ��ĸ��Ӽ�س�����ȡ��һ֡ͼ������ʼ����ϸ�˹ģ�ͻ�ӿ쳡�������������ٶȣ�����ȡ�ı����У�ֻ��������������������˶�Ŀ�걳��ѧϰ���ɵĴ���̬������

2.2 �˶�Ŀ����

���û��ģ���еı���ģ�;���Ȩֵ�ϴ����С���ص㣬���㷨ʹ�����ֵ��i,t/��i,t����������˹�ֲ���Ϊ����ģ�͵����ȼ���

�������ȼ��ϸߵ�ǰM����˹�ֲ������ı���ģ�ͣ��������ȼ��������ص���ʱ��t����ɫֵXt��M����˹�ֲ���һƥ�䣬��������ƥ�����������ж��õ�Ϊǰ���㣬�����Ϊ�����㣬�Ӷ����������Ӧ��ϸ�˹ģ���µ�Ŀ���⡣

��Ϊ����ģ����Ҫ������ʼ�������ڣ���ˣ���Ŀ�����ͬʱ����Ҫ�ж��˶�Ŀ���Ƿ��Ѿ���ȫ���볡�������ĶԼ��õ����˶�Ŀ��ǰ�����м��㣬��Ŀ���С��һ��ʱ���ڲ��ٱ仯ʱ�϶�Ŀ������ȫ���볡����Ȼ��Ŀ��Ļ�����������λ�ú���ɫ��Ϣ��������ģ�飬�Ӷ�ʵ�ֶ��˶�Ŀ����涯 ���١�

3 �˶�Ŀ�����

�Դ�Comaniciu��[6]�ѷǸ�������ĸ����������Ϊ�Ż������ֵƯ����Ŀ���������õ��˺ܺõ�Ӧ�á����㷨ʵʱ�Ժã�����Ŀ�����ת�������赲�������Լ������˶��������У������ڸ����������ϴ��ڽϴ����⡣���Ŀ������������֡��ƫ�ƽϴ�ͳ�ľ�ֵƯ���㷨��ʹ�ø��ٲ��ܼ����������˶�������, ���û����Խ�ǿ�Ŀ������˲���Ԥ���ֵƯ���㷨��Ŀ����ʼ�����ǽ����ȱ�ݽ�Ϊ��Ч�ķ���֮һ[8-9]��

�ڱ��ĵĸ���ģ���У�ϵͳ��������ź�ʹ����̨����Ŀ����˶����˶������������д����˶���Ŀ�꣬��������Ҳ���ڴ�Χ���˶���Ϊ��ʵʱ���ȶ��ظ����˶�Ŀ�꣬���Ľ��������˲������ھ�ֵƯ���㷨�����˲�������Ŀ����ڳ�����λ�õ����Ź�����Ϊÿһ֡�о�ֵƯ���㷨����ʼ�㣬�൱�ڶ�Ŀ��λ�ý���ȫ�ֵ�Ԥ���ƣ��ɾ�ֵƯ���㷨����ʼ��������ڵ����õ�����λ�ã�����������һ֡���˲����ƣ������㷨����ʹ�ã�����䡣

3.1 ��ֵƯ���㷨

��ֵƯ�Ʒ���[10]��һ��Ѱ�Ҹ����ܶȼ���ֵ���ݶ������������ṩ��һ���µ�Ŀ�������붨λ��ܣ������˼���ǣ�ͨ�������������������ռ������������ܼ������������������������ܶ����ӵķ���Ư�ơ����ֲ��ܶȼ���ֵ�㡣���ھ�ֵƯ�Ʒ�����Ŀ����ټ���ͨ�����ú˸����ܶ�������Ŀ�������,����Ŀ���ֱ��ͼ���������ȶ����������ڵ������㷽�����Լ�������С���ص㣬���IJ���ֱ��ͼ��Ŀ����н�ģ,Ȼ����������Զ��������þ�ֵƯ����������������Ŀ��λ�á�

��ֵƯ���㷨���������Ժ�������Ŀ��ģ�ͺ�Ŀ���ѡģ��֮������Ƴ̶ȣ����IJ��õ�Bhattacharyyaϵ����һ��ɢ���Ͳ�������ֱ�ӵļ�����������2��������Ƕȵ�����ֵ��Comaniciu��[6]֤�����ھ�ֵƯ���㷨��Bhattacharyyaϵ�����������������Ժ�����һ��ѡ��

����Ŀ�����������Ϊx0����ѡĿ������Ϊy��������n��������{xi}i=1, ��, n��ʾ������ֵ�ĸ���Ϊm������u(u=1, ��, m)��ʾ��Ŀ�����ѡĿ���ֱ��ͼģʽ�ֱ�Ϊ��Ŀ��![]() �ͺ�ѡĿ��

�ͺ�ѡĿ��![]() ��ʹ��Bhattacharyyaϵ����ΪĿ�����ѡĿ���ֱ��ͼģʽ�������Ժ���������Ϊ��

��ʹ��Bhattacharyyaϵ����ΪĿ�����ѡĿ���ֱ��ͼģʽ�������Ժ���������Ϊ��

![]() (2)

(2)

�ھ�ֵƯ���㷨���������У���Ҫ������Ŀ��ģ����Ŀ���ѡ֮�����Ƴ̶ȵ�Bhattacharyyaϵ������̩��չ����ȡǰ������бƽ���Ҫ��Ŀ�����������֡��ƫ�������ܳ����˺����Ĵ�����Ŀ�������ͼ��ƽ���ƶ��ܿ�����������ڵ���������̩��չ����ǰ���������ᵼ��Ŀ����ٵ�ͣ����Bhattacharyya ϵ���ľֲ���ֵ�����þֲ���ֵȴС��Ŀ�����ڴ���Bhattacharyya ϵ���� һ�������۵��൱�̶Ⱥ���ᵼ��Ŀ��©�����������뿨�����˲��������� ���⡣

3.2 ��Ͽ������˲����ľ�ֵƯ���㷨

�������˲������ڹ�������ϵͳ��״̬���������ò���ֵ�������Ƶ�״̬���ṩ�ɿ���״̬���ơ�ʹ�ÿ������˲�����ΪԤ������Ҫ����ϵͳ��״̬���̣���ͬ������������Ŀ�����˶����н�ģ[11]���������˲����۲�ģ�ͽ�������[12]��

�����˶�Ŀ��������X��Y���ϵ��˶�����һ����������ٶ��Ŷ�������ֱ���˶���Ŀ���˶�״̬������ʾΪ![]() �����У�x(m)��y(m)�ֱ���Ŀ��������X��Y���ϵ�λ�÷�����x��(m)��y��(m)�ֱ���Ŀ��������X��Y���ϵ��ٶȡ�Ŀ��۲�������ʾΪ

�����У�x(m)��y(m)�ֱ���Ŀ��������X��Y���ϵ�λ�÷�����x��(m)��y��(m)�ֱ���Ŀ��������X��Y���ϵ��ٶȡ�Ŀ��۲�������ʾΪ![]() ������xc(m)��yc(m)�ֱ�ΪĿ��������X��Y���ϵĹ۲�ֵ����Ŀ��״̬���̺۲ⷽ�̿ɲ������µ�ʽ��ʾ��

������xc(m)��yc(m)�ֱ�ΪĿ��������X��Y���ϵĹ۲�ֵ����Ŀ��״̬���̺۲ⷽ�̿ɲ������µ�ʽ��ʾ��

X(m)=F(m, m-1)X(m-1)+W(m) (3)

Y(m)=H(m)X(m)+V(m) (4)

ʽ�У�F(m, m-1)��״̬ת�ƾ���W(m)�����ֵ��˹״̬������H(m)�Dz������������ֵ��˹������������W(m)��V(m)Ϊ�ͳ�ƶ�����

�����и���ģ���㷨�IJ������£���kʱ��ϵͳ�������ģ��ʱ���ɼ��ģ��õ�(k-1)ʱ�̵�Ŀ���������꣬���ȷ�������ź�ʹ����̨����Ŀ����˶������ÿ������˲�Ԥ��kʱ��Ŀ���λ�ã�Ȼ����һ��Ԥ��Ľ��Ϊ���ģ�Ӧ�þ�ֵƯ���������ڵ���Ѱ�ţ������㼴�ǵ�ǰ֡kʱ��Ŀ������ڣ��������������Ϊ�������˲����Ĺ۲�ֵ��Ԥ��(k+1)ʱ��Ŀ����ʼλ�á�

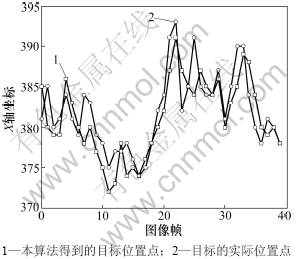

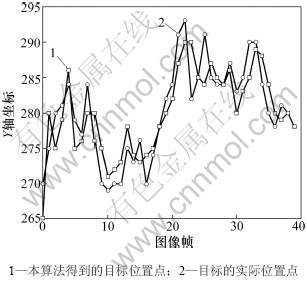

���ĶԲ��õĸ����㷨����ʵ�顣��ʵ���У��ֱ�ɼ���40֡�����ںϿ������˲��ľ�ֵƯ���㷨������Ŀ���X�ᡢY�����꣬��ʵ���˶�Ŀ�������λ�ý��бȽϣ���ͼ3��ͼ4��ʾ�����ķ��α�ʾ�ںϿ������˲��ľ�ֵƯ�Ƶõ���Ŀ��λ�õ㣬������Բ���ʾĿ���ʵ��λ�õ㣬���Կ������IJ��õ��㷨�ܺܺõĸ���Ŀ�ꡣ

ͼ3 X���ϸ��ٵõ���Ŀ��λ�õ���Ŀ��ʵ��λ�õ�

Fig.3 Target position in X-axis obtained by proposed method, compared with actual location

Ϊ��ʵ�ֶ�Ŀ����ȶ����٣����ķ������˶�Ŀ����ٹ����п��ܳ��ֵ������������ģ��õ���λ����Ϣ��һ��ʱ����û�з����仯ʱ������Ϊ���ܳ���Ŀ�궪ʧ״̬����������������½����˶�Ŀ����ģ�顣

ͼ4 Y���ϸ��ٵõ���Ŀ��λ�õ���Ŀ��ʵ��λ�õ�

Fig.4 Target position in Y-axis obtained by proposed method, compared with actual location

��ʵʱ�Է��棬����ʹ�ÿ������˲���Ԥ���������ڳ�ʼλ�õļ�����ֻռ����Ŀ�����ģ���������ĺ�Сһ���֣�����Ӱ�쵽����Ŀ������㷨��ʵʱ�ԣ� �෴�������Լ���ÿ֡�ھ�ֵƯ���㷨�����Ĵ������Ӷ������Ŀ��ĸ���Ч�ʡ�

4 ʵ���������

ʵ�����װ���ڹ̶����ż��ϵ�ά��ͼ��˾MV-5959�߾����Ӿ�ת̨��װ��1��MV-VS078 FC���ٹ�ҵCCD��������ɼ���Ƶͼ��Ϊ���ɫ��ʽ��֡��25 ֡/s��ÿ֡ͼ��Ϊ640��480���أ�PC����Ƶ2.93 GHz���ڴ�1 GB������ϵͳΪMicrosoft Windows XP Professional�������д����ΪVC 6.0��

�ڻ�ϸ�˹ģ�ͼ���˶�����ʱ���ٶ����ص�R��G��B����ɫͨ���������ȡֵ����[0��255]��Χ�ڣ��������еĸ�˹ģ�Ͷ��ǻ������صģ���ÿ�����ؽ���һ��ģ�ͣ�����֮��ı���ģ�����������ʵ����ȡ��˹ģ����K=3��

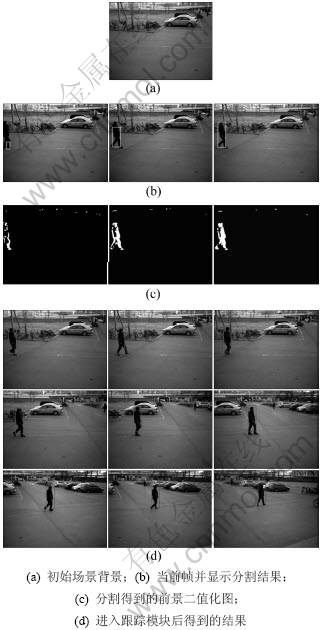

ͼ5��ʾΪ������²��ԵĽ����ʾ��ͼ5(a)��ʾΪ��ϸ�˹��ģ�õ��ij�ʼ�ij���������ͼ5(b)��(c)��ʾ���˶�Ŀ��ս��볡����δ�ȶ�ʱ��ϵͳʹ�û�ϸ�˹ģ�ͶԳ�����ģ���õ��ķָ���ǰ������ɫ���ʾ������ʾ������ʾ����ͼ5(b)��(c)���Կ��������ܳ���Զ�������˶��ij��������˶�Ŀ�����ȷ��Ⲣû�����Ӱ�졣

ͼ5 ��������˶�Ŀ��ļ�������ʵ��

Fig.5 Detection and tracking in scenes of outdoor environment

��Ŀ��Ĵ�С�����Ա仯ʱϵͳ��ΪĿ����ȫ���볡������ʱϵͳ��������ź�ʹ����̨����Ŀ����˶������ý�Ͽ������˲��ľ�ֵƯ���㷨��Ŀ����и��٣��õ��Ľ���ú�ɫ���ʾ����ʾ����ͼ5(d)��ʾ����ͼ5(d)�ĵ�һ���У��˶�Ŀ���˶��ٶȽϿ죬��̨����ʱ��ת����ʹĿ�괦�ڳ������ĵ�λ�ã����ڱ����㷨�п������˲��ļ��룬��������֮֡��Ŀ���˶�����������û�г��ָ����������

��ʵ�������Կ�����Ŀ�������2��ģ���ν�˳�����õ��˽Ϻõ�Ч����

5 ����

�����һ�ֻ����˶��������ʵʱ���ٷ������������������ֹ������Ի�ϸ�˹����ģ��Ϊ�������˶�Ŀ����м�⣬Ȼ���ý�Ͽ������˲��ľ�ֵƯ���㷨���˶�Ŀ������涯���١�����ķ����ڲ���������ͷ��ǰ���£��������˶��˶�Ŀ����и��ٵ���Ұ��Χ���ֱ�֤�˼����ٵ�ʵʱ�ԡ�ʵ�����������㷨������Ч��ʵ�ֶ��˶�Ŀ��ļ����˶������µ�Ŀ����١�

�ο����ף�

[1] Gavrila D M. The visual analysis of human movement: A survey[J]. Computer Vision and Image Understanding, 1999, 73(1): 82-98.

[2] Haritaoglu I, Harwood D, Davis L S. W4: Real-time surveillance of people and their activities[J]. IEEE Transaction on Pattern Analysis and Machine Intelligence(S0162-8828), 2000, 22(7): 809-830.

[3] Lipton A, Fujiyoshi H, Patil R. Moving target classification and tracking from real-time video[C]//Proceeding of IEEE Workshop on Applications of Computer Vision. Princeton, NJ, USA, 1998, 19-21.

[4] Barron J, Fleet D, Beauchemin S. Performance of optical flow techniques[J]. International Journal of Computer Vision, 1994, 12(1): 43-77.

[5] Tsaig Y, Averbuch A. Automatic segmentation of moving objects in video sequences: A region labelingapproach[J]. IEEE Transactions on Circuits and System forVideo Technology, 2002, 12(7): 597-612.

[6] Comaniciu D, Ramesh V, Meer P. Kernel-based object tracking [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25(5): 564-577.

[7] Stauffer C, Grimson W. Adaptive background mixture models for real-time tracking[J]. IEEE Conference on Computer Vision and Pattern Recognition. Fort Collins, Colorado, 1999: 246-252.

[8] Eberhart R C, Kennedy J. A new optimizer using particle swarm theory[C]//Proceeding on 6th International Symposium on Micro Machine and Human Science. Nagoya, 1995: 39-43.

[9] ��ʤ��, ���ư�, ����. �����˶�Ŀ���MeanShift�����㷨[J]. ��繤��, 2006, 33(5): 66-70.

ZHU Sheng-li, ZHU Shan-an, LI Xu-chao. Algorithm for tracking of fast motion objects with mean shift[J]. Opto-Electronic Engineering, 2006, 33(5): 66-70.

[10] �ݵ�, ΤΡ, ��Զ��. һ�ֻ��ڿ�����Ԥ��Ķ�̬Ŀ������㷨�о�[J]. ��繤��, 2009, 36(1): 52-63.

YU Dan, WEI Wei, ZHANG Yun-hui. Dynamic target tracking with Kalman filter as predictor[J]. Opto-Electronic Engineering, 2009, 36(1): 52-63.

[11] �ܷ���, ����ƽ, Ҷ�. ��ֵƯ���㷨���о���Ӧ��[J]. ���������, 2007, 22(8): 841-847.

ZHOU Fang-fang, FAN Xiao-ping, YE Zhen. Mean shift research and applications[J]. Control and Decision, 2007, 22(8): 841-847.

[12] �����, �ҽ��, ���ٻ�����. ���ڿ������˲����ƶ��������˶�Ŀ�����[J]. ��������ϵͳ, 2008, 27(11): 66-68, 71.

LI Qing-ying, CHU Jin-kui, LI Rong-hua, et al. Moving object tracking algorithm for mobile robot based on Kalman filter[J]. Transducer and Microsystem Technologies, 2008, 27(11): 66-68, 71.

(�༭ Ԭ��ǰ)

�ո����ڣ�2011-04-15�������ڣ�2011-06-15

������Ŀ��ʡ�����ص������Ŀ(9140A17051010BQ0104)

ͨ�����ߣ���ӱ��(1989-)��Ů�����������ˣ�˶ʿ�о���������Ŀ����������о����绰��15001385910; E-mail: yinghuilei@yahoo.cn

ժҪ������涯���ϵͳ�µ��˶�ǰ��Ŀ�꣬���һ�ָĽ���ʵʱĿ��������ٷ��������ȣ����˶�Ŀ����ν�����Ƶ����ʱ��ͨ����������Ӧ��ϸ�˹ģ�͵ķ�����ȡ�˶�Ŀ�ꡣȻ�������ں��˿������˲��ľ�ֵƯ���㷨���˶�Ŀ�����Ԥ����٣�ʹ���ܴ����涯ϵͳ����Ұ���ġ�������㷨�ȱ�֤�˼����ٵ�ʵʱ�ԣ��������˶��˶�Ŀ����и��ٵ���Ұ��Χ��ʵ�������������㷨�ܹ�ʵʱ�Զ��ض��˶�Ŀ����м�����涯���١�