DOI: 10.11817/j.issn.1672-7207.2016.09.018

基于局部背景特征点的目标定位和跟踪

张铁,马琼雄

(华南理工大学 机械与汽车工程学院,广东 广州,510641)

摘要:针对存在多个与目标相似的区域以及摄像头经常运动的跟踪问题,提出一种基于局部背景特征点的目标定位和跟踪方法。首先,根据相邻匹配的局部背景特征点与目标的位置关系对目标进行定位,然后,以定位得到的预测位置作为搜索起点,结合粒子滤波和均值偏移方法获取目标的候选区域,最后,根据候选区域和预测位置的距离对候选区域的相似度加权,将加权后相似度最高的候选区域作为跟踪结果。研究结果表明:该算法能够避免周围相似物体的干扰并准确跟踪目标,具有较好的鲁棒性和实时性。

关键词:粒子滤波;均值偏移;局部背景特征点;目标定位;目标跟踪

中图分类号:TP391 文献标志码:A 文章编号:1672-7207(2016)09-3040-10

Target location and tracking based on local background feature points

ZHANG Tie, MA Qiongxiong

(School of Mechanical & Automotive Engineering, South China University of Technology, Guangzhou 510641, China)

Abstract: To solve the problems of multiple similar objects and camera motion in target tracking, a method of target location and tracking was proposed based on local background feature points. Firstly, a target position was predicted by considering the position relation between the target and the matched feature points surround target of previous image. Then candidate objects were searched starting from the predicted position by combining particle filter and mean shift. Finally, the similarity of each candidate object was weighed by the distance between candidate object position and predicted position. The final target was the candidate object with the highest similarity. The results show that the proposed algorithm can track targets accurately in the presence of surrounding similar objects, and it possesses strong robustness and good real-time performance.

Key words: particle filter; mean shift; local background feature; target location; target tracking

粒子滤波、均值偏移以及他们相结合的方法已经普遍应用到视觉跟踪领域。粒子滤波是从目标状态的后验概率中抽取随机状态粒子,并通过观测目标与模板的相似度修正各粒子权重,最终联合各粒子来表示目标状态分布,在处理非线性、非高斯系统的状态和参数估计问题方面具有独到的优势[1-2]。均值偏移通过非参数估计方法计算跟踪目标的概率密度,并沿着该密度函数梯度方向快速迭代收敛至其峰值,计算简单,具有很好的实时性。但是均值偏移方法只能寻找局部最大值而不是全局最大值,如果2帧图像之间没有足够的重叠部分都会导致丢失目标[2]。基于粒子滤波跟踪方法的关键在于以使粒子有效地分布于目标分布峰值所在的区域。为了达到更好的跟踪效果,许多学者从各个方面进行了研究。如把均值偏移算法引入粒子滤波框架中使粒子聚集到后验峰值附近[1, 3],并结合多特征融合[4-5]、核直方图[1-2]、背景加权[6]等方法减少背景干扰来提高目标特征的描述能力。移动机器人在交互过程中摄像头会发生转动和移动,即使目标静止不动,目标在相邻时刻的2帧图像中的位置可能变化很大,并且由于人体的表观特征(如头部、躯干等)比较相似,移动机器人在多人环境下跟踪特定的人容易受到周围人的影响。因此,不能以上帧的目标位置作为起始位置搜索局部最优值,需要在搜索前对目标进行全局定位才能够提高粒子滤波和均值偏移等方法的跟踪效果。虞旦等[7]使用卡尔曼滤波补偿摄像头运动造成目标在像平面的偏移,并结合均值偏移实现对人体的跟踪,但是在建模时需要将机器人的运动一起考虑进去,比较复杂。JUNG等[8]通过匹配特征点,求出相邻时刻2幅图像的仿射变化矩阵,补偿摄像头自身运动造成的目标在图像上的偏移,然后使用粒子滤波跟踪运动目标。张笑微等[3]先使用灰度图像模板获取目标在当前帧的大致位置之后,以该位置为中心,均匀选取4个粒子进行均值偏移,使每个粒子通过收敛到局部的极值点,然后通过粒子加权的方法得到最终目标位置。江晓莲等[9]将视觉显著性和Wang-Landau蒙特卡罗采样方法结合起来,提高全局采样的效率。近几年在线学习和基于上下文的跟踪方法也逐渐发展起来。CERMAN等[10]提出的“Sputnik Tracker”通过学习能够识别与目标物体黏着运动的区域,通过这些区域提供目标的位置信息,克服遮挡以及外观突变等问题;YANG等[11]利用在一个较短的时间段内和目标保持一致的运动关系辅助物体(auxiliary objects)提供目标的位置信息,从而提高跟踪效果。GRABNER等[12]提出了支持者(supporters)的概念,从图像中抽取出在物体表面并且和目标的运动有较高相关性的特征点,通过这些局部特征来投票确定目标的位置。DINH等[13]首先寻找所有和目标相似的区域(distracters),然后在目标周围寻找有用的信息(supporters)避免错误跟踪到相似区域。文献[10-13]用特征点计算目标位置,要求这些特征点在一定时间周期内和目标具有运动相关性,需要记录1个时间段内特征点的信息并分析它们和目标之间的运动关系来确定是否还有效,计算量相对比较大,并且在1个时间段内和目标保持一致运动关系的特征点比较难找。本文作者将图像中和所有和目标相似的区域(即文献[13]中的Distracters)定义为候选区域。针对摄像头移动导致目标在相邻2帧之间的位置变化较大以及存在多个候选区域的情况,首先利用目标周围特征点的信息预测目标的位置,然后用改进的融合均值偏移的粒子滤波方法来获取候选区域,根据候选区域和预测目标位置的距离计算每个候选区域的距离权重,将加权后相似度最高的候选区域作为跟踪结果,提高现有跟踪算法的跟踪效果。

1 目标定位算法

移动机器人在运动过程中拍摄回来的图像一般只有平移和缩放的变化,较少有旋转的变化。每个特征点和它周围的特征点存在着固定的相对位置关系,根据上一时刻图像特征点和目标的位置关系以及当前图像中匹配的特征点位置,可以估算当前帧的目标位置。

在特征点检测、描述以及匹配方面前人已经进行了大量的研究[14-16],本文作者在前人研究的基础上,针对估算目标位置的需求,在特征点的选择、描述以及匹配方法上进行相应改进。为描述方便,下文将上一时刻(t-1时刻)的图像称为模板图像,将当前时刻(t时刻)的图像称为观测图像。

1.1 获取特征点

采用ROSTEN等[16]提出的快速特征点检测方法来获取原始特征点。为了减少计算量,只在模板图像的目标周围检测特征点。定义模板图像的特征点检测范围Sm是以目标中心为中心的矩形区域。为了保证能在观测图像中找到模板图像的部分特征点,将检测范围以目标中心为中心平均划分为上、下、左、右4个矩形子区域,并保证每个子区域都有一定数量的特征点。特征点数量太少容易导致找不到匹配的特征点,数量太多又影响运算速度,因此,检测范围Sm是根据上一时刻匹配的特征点数量Nf动态变化的,当匹配的特征点数量Nf少于阈值Tnf时,则增大Sm,否则减小Sm,其变化如下式所示:

(1)

(1)

式中:Sm(t)为t时刻模板图像的特征点检测范围; 为

为 时刻模板图像的特征点检测范围。

时刻模板图像的特征点检测范围。

相邻特征点的特征相似而且对目标位置预测的贡献接近,因此,在1个范围内只选择1个特征点作为代表。定义以1个特征点为中心,半径为Rmp的圆形区域作为代表特征点范围,在该范围内的其他特征点则忽略不用。

类似地,用相同的方法在观测图像中检测代表特征点。不同之处在于:由于不确定目标在观测图像中的位置,因此,需要检测观测图像所有的特征点。设观测图像的代表特征点范围半径为R op。

1.2 特征点模型

为了描述简便,以下将“代表特征点”简称为“特征点”。以特征点为中心,边长为Wf的正方形区域来描述特征点,借鉴文献[1-2]的粒子滤波和均值偏移方法中通过特征集合描述目标模型和候选目标模型的方法,将在模板图像中的特征点模型定义为目标特征点,其模型 定义为

定义为

,

,

其中:m为特征的个数; 表示目标特征点模型的第u个特征值。

表示目标特征点模型的第u个特征值。

类似地,将观测图像中需要和目标特征点匹配的特征点定义为候选特征点,中心为y的候选特征点模型 定义为

定义为

,

,

其中: 表示候选特征点的第u个特征值。

表示候选特征点的第u个特征值。

在本文中,使用HSV颜色直方图描述模型的特征,设y表示候选特征点的中心,目标特征点和候选特征点的相似度使用Bhattacharyya系数 来衡量,可表示为

来衡量,可表示为 ,其计算方法为

,其计算方法为

(2)

(2)

越大,表示目标特征点和候选特征点的相似度越高,它们是匹配特征点的可能性越大。

越大,表示目标特征点和候选特征点的相似度越高,它们是匹配特征点的可能性越大。

1.3 匹配特征点

将模板图像中的特征点及其匹配的观测图像特征点称为1对“匹配特征点对”。1对匹配特征点对f包括它在模板图像中的特征点 和观测图像中的特征点

和观测图像中的特征点 。模板图像中第i个特征点

。模板图像中第i个特征点 在图像上的位置

在图像上的位置 表示为

表示为 ,

, 和

和 分别是

分别是 在模板图像上的x坐标和y坐标;观测图像中第j个特征点

在模板图像上的x坐标和y坐标;观测图像中第j个特征点 在图像上的位置

在图像上的位置 表示为

表示为 ,

, 和

和 分别是

分别是 在观测图像上的x坐标和y坐标。按上节所述方法分别对每个特征点建立特征模型。设Tmmo是模板图像的特征点与观测图像特征点匹配的相似度阈值,若2个特征点的相似度大于阈值Tmmo,则认为2个特征点有可能匹配,可以将其作为候选的匹配特征点。由于有的特征点在观测图像中存在多个相似度超过阈值Tmmo的特征点,甚至真正匹配的特征点相似度低于其他特征点,因此,还需要筛选候选的匹配特征点。

在观测图像上的x坐标和y坐标。按上节所述方法分别对每个特征点建立特征模型。设Tmmo是模板图像的特征点与观测图像特征点匹配的相似度阈值,若2个特征点的相似度大于阈值Tmmo,则认为2个特征点有可能匹配,可以将其作为候选的匹配特征点。由于有的特征点在观测图像中存在多个相似度超过阈值Tmmo的特征点,甚至真正匹配的特征点相似度低于其他特征点,因此,还需要筛选候选的匹配特征点。

每个特征点和它周围的特征点存在着一定的相对位置关系,即若已经准确匹配出Nm对特征点,则对于某个特征点来说,它和这Nm对特征点的相对位置关系接近,可以利用特征点之间的相对角度和距离来实现特征点的匹配[14-15]。在本文提出的特征点匹配方法中,除了特征点的相似度要超过阈值Tmmo之外,还要求2个特征点在模板图像中的相对位置和在观测图像中的相对位置相同。

用模板图像和观测图像中2对特征点的相对位置误差来描述他们之间的匹配程度,第i对特征点fi和第j对特征点fj的相对位置误差定义为d(fi, fj),其计算方法为

(3)

(3)

其中: 为在模板图像中特征点

为在模板图像中特征点 和特征点

和特征点 之间的距离,表示为

之间的距离,表示为 ;

; 为模板图像中第i个特征点

为模板图像中第i个特征点 在图像上的位置;

在图像上的位置; 为模板图像中第j个特征点

为模板图像中第j个特征点 在图像上的位置;

在图像上的位置; 为在观测图像中特征点

为在观测图像中特征点 和特征点

和特征点 之间的距离,

之间的距离,  ;

; 为观测图像中第i个特征点

为观测图像中第i个特征点 在图像上的位置;

在图像上的位置; 为观测图像中第j个特征点

为观测图像中第j个特征点 在图像上的位置。如果

在图像上的位置。如果 等于0表示2对特征点相对位置关系完全吻合,都是匹配特征点的可能性很大。反之,

等于0表示2对特征点相对位置关系完全吻合,都是匹配特征点的可能性很大。反之, 越大则表示2对特征点的相对位置关系越不吻合,都是匹配特征点的可能性很小。只要能够首先确定出1对匹配特征点,作为基准位置特征点对

越大则表示2对特征点的相对位置关系越不吻合,都是匹配特征点的可能性很小。只要能够首先确定出1对匹配特征点,作为基准位置特征点对 ,则可以通过式(3)判断其他对特征点是否匹配。

,则可以通过式(3)判断其他对特征点是否匹配。

基准位置特征点对 的计算方法如下:以观测图像中和模板图像特征点相似度最高的特征点作为匹配特征点,得到N对匹配特征点的集合。将集合中第i对特征点和其余特征点对的相对位置误差总和定义为特征点位置误差总和,表示为

的计算方法如下:以观测图像中和模板图像特征点相似度最高的特征点作为匹配特征点,得到N对匹配特征点的集合。将集合中第i对特征点和其余特征点对的相对位置误差总和定义为特征点位置误差总和,表示为 ,其计算公式为

,其计算公式为

(4)

(4)

其中: 为第i对特征点fi和第j对特征点fj的相对位置误差。若

为第i对特征点fi和第j对特征点fj的相对位置误差。若 越小,则说明和特征点fi相对位置误差小的特征点对越多,在大部分特征点相对位置保持不变的情况下,可以选择特征点位置误差总和最小的特征点对作为基准位置特征点对

越小,则说明和特征点fi相对位置误差小的特征点对越多,在大部分特征点相对位置保持不变的情况下,可以选择特征点位置误差总和最小的特征点对作为基准位置特征点对 。

。

因此,对于模板图像中的特征点 ,它在观测图像中匹配的特征点

,它在观测图像中匹配的特征点 除了和

除了和 相似度大于阈值

相似度大于阈值 之外,还要求

之外,还要求 和

和 组成的特征点对

组成的特征点对 与

与 的相对位置误差最小,其计算方法为

的相对位置误差最小,其计算方法为

(5)

(5)

其中: 为第j个候选的匹配特征点对,由模板图像的特征点

为第j个候选的匹配特征点对,由模板图像的特征点 和观测图像的特征点

和观测图像的特征点 组成;

组成; 和

和 分别表示

分别表示 和

和 的相似度,其计算方法如式(2)所示。

的相似度,其计算方法如式(2)所示。

1.4 估计目标位置

通过式(5)获得的K对匹配的特征点 来定位目标。首先分析特征点的类型以及在目标定位中的作用。

来定位目标。首先分析特征点的类型以及在目标定位中的作用。

图1所示来自公共数据集CAVIAR[17]的ThreePastShop1cor视频。图1中未标号的圆点为没有匹配成功的特征点,圆点1~10是匹配的特征点。在模板图像中,直线的交点处是目标中心位置,直线代表了特征点和目标的位置关系;在观测图像中,直线的交点位置是根据特征点位置关系计算出来的目标位置。匹配的特征点包含静态背景特征点和随动背景特征点2种。

1) 静态背景特征点:这些特征点在图像中的相对位置不会发生变化,一般分布在静态背景中,如特征点1~7。利用静态背景特征点和目标的相对位置关系可以计算出模板图像目标位置在观测图像中的相应位置。

2) 随动背景特征点:在模板图像和观测图像中存在一些和目标保持着一致运动关系的特征点,这些特征点可能分布在与目标相连接的区域,如特征点10;也可能分布在和目标相对独立的运动物体上,如特征点8和9。利用随动背景特征点可以计算出观测图像中目标所在的位置。

通过背景特征点估算目标的位置使起始搜索位置接近目标位置,粒子有效地分布于目标分布峰值区域,可以提高粒子滤波、均值偏移等方法的跟踪效率,而且只使用上1帧特征点和目标信息,方法相对简单而且计算量小。

在通过式(5)获得K对匹配的特征点中,根据第i对特征点估算出目标位置 表示为

表示为

(6)

(6)

其中: 为目标在模板图像中的位置;

为目标在模板图像中的位置; 为模板图像中第i个特征点的位置;

为模板图像中第i个特征点的位置; 为观测图像中匹配的第i个特征点的位置。

为观测图像中匹配的第i个特征点的位置。

在匹配的特征点集合中,对于位置误差总和越小的特征点对,和它相对位置发生变化的特征点数量最少,用它来估计位置的可靠性更高,而相对位置误差越大的特征点,和它相对位置发生变化的特征点越多,则用它来估算位置可靠性更高,因此,每个特征点对估算目标位置的权重不同。特征点 估算位置的权重

估算位置的权重 用高斯函数表示为

用高斯函数表示为

(7)

(7)

其中: 为高斯函数标准差;

为高斯函数标准差; 为第i个特征点位置误差总和

为第i个特征点位置误差总和 归一化后的值。

归一化后的值。

由K对特征点估算的目标位置 的计算公式为

的计算公式为

(8)

(8)

其中: 为

为 归一化的权重。

归一化的权重。

图1 特征点类型

Fig. 1 Categories of feature points

2 跟踪算法

2.1 改进的融合均值偏移的粒子滤波方法

粒子滤波算法包括初始化粒子集、重要性采样/序贯重要性采样、更新粒子权值、重采样以及状态输出等几个基本部分。常见的融合均值偏移的粒子滤波方法是在粒子采样过程中先将粒子均值偏移到局部极值点,然后再通过粒子加权的方法得到最终目标位置[1, 3]。本文在粒子采样阶段和状态输出阶段进行如下改进。

粒子采样阶段的改进说明如下:由于目标周围还存在其他的候选区域,因此,很难通过简单特征对目标进行粗定位,然后在定位位置周围放置粒子[3]。用矩形框 来描述粒子,y表示粒子的中心位置,矩形框的宽度w和高度h分别表示粒子宽度和高度。粒子的模型和1.2节特征点的模型描述方式相同。设粒子在x方向上的变化幅度为

来描述粒子,y表示粒子的中心位置,矩形框的宽度w和高度h分别表示粒子宽度和高度。粒子的模型和1.2节特征点的模型描述方式相同。设粒子在x方向上的变化幅度为 ,粒子在y方向上的变化幅度为

,粒子在y方向上的变化幅度为 ,则粒子的分布范围是宽为

,则粒子的分布范围是宽为 ,高为

,高为 的矩形区域。在粒子分布范围内均匀分布粒子,并且相邻粒子中心在x方向的距离等于粒子宽度w,在y方向上的距离等于粒子的高度h,即保证在当前帧目标的中心位置在上一帧目标所覆盖的区域时,Bhattacharyya系数的局部最大值可以使均值偏移方法可靠地收敛到目标位置[2]。

的矩形区域。在粒子分布范围内均匀分布粒子,并且相邻粒子中心在x方向的距离等于粒子宽度w,在y方向上的距离等于粒子的高度h,即保证在当前帧目标的中心位置在上一帧目标所覆盖的区域时,Bhattacharyya系数的局部最大值可以使均值偏移方法可靠地收敛到目标位置[2]。

状态输出阶段的改进说明如下:当目标周围存在其他的候选区域时,粒子经过均值偏移之后,有可能收敛到各个局部峰值位置,不同方向粒子进行加权运算时会相互抵消,造成跟踪精度下降。因此,在每个粒子通过均值偏移运算收敛到局部极值点后,根据粒子的分布位置将这些粒子划分为若干个代表候选区域的粒子子集。通过粒子子集中的粒子加权得到若干个候选区域之后,根据候选区域和起始位置的距离对候选区域的相似度进行加权,距离起始位置越近的候选目标权重越大,本文以高斯函数作为核函数对相似度进行加权。最后选择相似度最高的候选区域作为目标。

将粒子划分到相应候选区域的粒子集的方法说明如下:从粒子集中选择权值最高的粒子作为1个候选区域的中心,设以该中心为中心,半径为目标外接圆半径1.2倍的圆作为粒子集的粒子分布范围。将范围内的粒子都划分在这个候选区域的粒子子集中,然后依次从未划分到候选区域的粒子中选择权值最高的粒子作为新的候选区域的中心,将在分布范围内的粒子划分到这个候选区域的粒子子集中。重复上述步骤,直到所有的粒子都被划分到相应的候选区域的粒子集中为止。

2.2 跟踪算法流程

通过局部背景特征点估算目标位置,再以该位置作为起点搜索目标,利用的粒子滤波方法对存在多个候选区域的图像进行跟踪,流程归纳如下。

步骤1:手动选定目标区域,按2.1节所述的方法建立目标模型,将当前图像作为模板图像分别按1.1节和1.2节的方法检测模板图像中的特征点和建立特征点模型。

步骤2:获取下1帧图像作为观测图像,估算目标的位置。分别按1.1节和1.2节的方法检测观测图像中的特征点和建立特征点模型;按1.3节的方法匹配特征点;再按1.4节的方法估算目标位置。

步骤3:以步骤2估算的目标位置为中心,按2.1节的方法跟踪目标。

步骤4:以观测图像作为模板图像,以步骤3得到的目标作为当前的目标,跳转到步骤2。

3 实验结果及分析

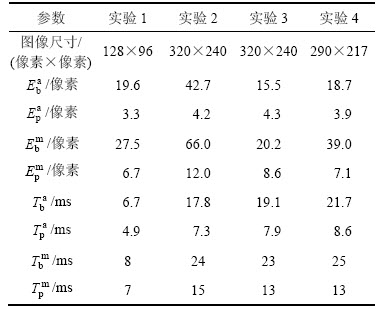

本算法实验的运行环境为Windows7系统,Intel Core i7-2670QM处理器(主频2.2 G),内存为3 G,基于开源图像处理工具EmguCV在VS2010平台上使用C#进行算法开发。以文献[1, 3]中融合均值偏移的粒子滤波方法作为基本跟踪算法,简称为“BT”方法,将本文研究的结合定位的跟踪算法称为“LBT”方法。选择具有多候选区域的室内外环境图像序列进行实验,首先在各个图像序列中选择2帧图像作为模板图像和观测图像,对基于局部背景特征点的定位在跟踪中的作用进行分析,然后对“BT”和“LBT””法的跟踪结果进行对比分析,最后对定位方法的性能进行分析。

3.1 跟踪结果分析

实验1的图像来自公共数据集“Videos for Head Tracking”[18]的seq_villains1序列;实验2的图像来自自己拍摄的视频数据;实验3和实验4的图像分别来自公共数据集TLD[19]的pedestrian2和carchase序列。为了公平比较2种方法的运行时间,控制“BT”方法中粒子的分布范围满足能够覆盖到目标的要求而不至于因为粒子数太多而影响效率。粒子在x方向上的变化幅度 ,在y方向上的变化幅度

,在y方向上的变化幅度 ;而对于“LBT”方法,粒子x方向上的变化幅度

;而对于“LBT”方法,粒子x方向上的变化幅度 ,在y方向上的变化幅度

,在y方向上的变化幅度 。此外,“LBT”算法的其他参数设置如下:模板图像代表特征点范围的半径

。此外,“LBT”算法的其他参数设置如下:模板图像代表特征点范围的半径 ;观测图像代表特征点范围的半径

;观测图像代表特征点范围的半径 ;初始时刻(

;初始时刻( )模板图像的特征点检测范围

)模板图像的特征点检测范围 为目标尺寸的4倍;匹配特征点数目的阈值

为目标尺寸的4倍;匹配特征点数目的阈值 ;描述特征点区域的正方形边长

;描述特征点区域的正方形边长 ;特征点匹配的相似度阈值

;特征点匹配的相似度阈值 ,候选区域权重高斯核函数的标准差为0.7;特征点估算目标位置权重函数的标准差

,候选区域权重高斯核函数的标准差为0.7;特征点估算目标位置权重函数的标准差 。

。

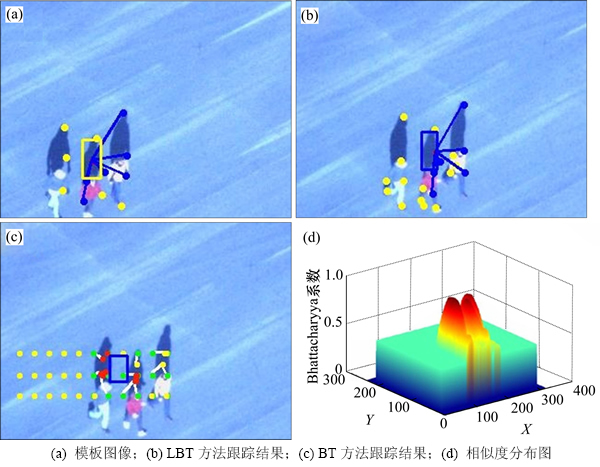

在实验结果图2~5中,不同圆点、直线以及它们交点的含义和图1相同。在每幅图中,子图(a)的矩形框是目标区域;子图(b)中矩形框是“LBT”方法得到的目标区域;子图(c)中的矩形框是“BT”得到的目标区域;子图(d)是观测图像中目标区域的Bhattacharyya相似度分布图,计算公式如式(2)所示。

第1组实验选择的观测图像右边的人脸更接近于图2(a)中目标的位置。图2(b)和图2(c)的矩形区域是2个候选区域。根据“LBT”方法,首先根据特征点对目标进行定位,得到的位置如图2(b)中直线的交点所示,接近图2(b)的候选区域,该候选区域具有最高的权重,因此能够准确跟踪到目标;而对于“BT”方法,如图2(c)所示,由于观测图像中右边的人脸位置更接近于模板图像中目标的位置,因此,错误地跟踪到右边候选区域。

第2组实验图像中存在3个和目标相似的区域,并且相似度接近,如图3(d)所示。图3(b)和图3(c)所示的矩形区域是2个被检测出来的候选区域。经过背景特征点定位之后,定位位置接近图3(b)区域的位置,因此,它具有较高的权重,在2个候选区域与目标的相似度都接近的情况下,“LBT”方法能够准确跟踪到目标。而对于“BT”方法,由于观测图像中右边的人脸位置更接近于模板图像中目标的位置,因此,错误地跟踪到右边候选区域。

第3组实验的图像为户外环境,背景颜色单一,不利于寻找特征点,特征点主要分布在3个行人以及他们的影子上。选择中间行人的影子作为目标,如图4(d)所示,3个影子和目标的相似度都比较接近。在“LBT”方法中,用于定位的特征点分布在行人及其影子上,由于行人和他们的影子在2幅图像中保持着接近的运动关系,把它们都看作是随动背景特征点,通过特征点估算出来的位置接近真实目标的位置,该位置的候选区域具有较高的位置权重,因此,“LBT”方法能够准确跟踪目标。而对于“BT”方法,由于观测图像中左边的影子位置更接近于模板图像中目标的位置,在相似度接近时,跟踪结果会向左边的人影偏移,导致“BT”方法跟踪误差较大。

图2 实验1结果

Fig.2 Results of Test No.1

图3 实验2结果

Fig.3 Results of Test 2

图4 实验3结果

Fig. 4 Results of Test 3

图5 实验4结果

Fig. 5 Results of Test 4

第4组实验的目标为正在行驶的车辆,如图5(d)所示,与目标相似度高的区域较多。在“LBT”方法中,用于定位的特征点分布在目标周围的车辆及其影子上,是随动背景特征点,通过特征点估算出来的位置接近真实目标的位置,该位置的候选区域具有较高的位置权重,因此,“LBT”方法能够准确跟踪目标。而对于“BT”方法,由于粒子分布在不同的候选区域上,加权之后不同方向的粒子作用相互抵消,导致估算出来的目标位置在2个候选区域之间,跟踪误差较大。

定性分析完“LBT”方法中基于局部特征点定位在跟踪中的作用,以下以上述4个图像序列分别用“LBT”和“BT”方法进行试验,对比跟踪误差和跟踪时间。“BT”方法获得的目标中心与真实目标中心的欧式距离称为基本跟踪误差,平均基本跟踪误差用 表示,最大基本跟踪误差用

表示,最大基本跟踪误差用 表示;“BT”方法跟踪目标的时间为基本跟踪时间,平均基本跟踪时间用

表示;“BT”方法跟踪目标的时间为基本跟踪时间,平均基本跟踪时间用 表示,最大基本跟踪时间用

表示,最大基本跟踪时间用 表示;“LBT”方法获得的目标中心与真实目标中心的欧式距离称为跟踪误差,平均跟踪误差用

表示;“LBT”方法获得的目标中心与真实目标中心的欧式距离称为跟踪误差,平均跟踪误差用 表示,最大跟踪误差用

表示,最大跟踪误差用 表示;“LBT”方法跟踪所用的时间为跟踪时间,平均跟踪时间用

表示;“LBT”方法跟踪所用的时间为跟踪时间,平均跟踪时间用 表示,最大跟踪时间用

表示,最大跟踪时间用 表示;结果如表1所示。

表示;结果如表1所示。

从表1可以看出:“LBT”方法通过背景特征点定位之后,跟踪误差小于“BT”方法的跟踪误差,而且从上面4组实验的分析可知“BT”方法容易因为分布在其他候选区域上粒子的影响而错误跟踪到非目标区域。在跟踪时间方面,由于“LBT”方法能够根据背景特征点定位出目标的位置,可以缩小搜索范围,可减少粒子数量,所以,在不同环境和不同图像尺寸的图像序列中,跟踪时间相差不大。而对于“BT”方法,跟踪时间受粒子数量以及粒子均值偏移迭代次数的影响,为了适应摄像头移动导致目标在相邻2帧之间的位置变化较大的情况,粒子的采样范围需要增大到可以覆盖到目标位置,因此,“BT”需要粒子的数量大于“LBT”方法。虽然“LBT”方法增加了一个用局部特征点定位和划分候选区域的过程,但通过正确对目标粗定位,降低了跟踪误差和跟踪时间。

表1 跟踪结果

Table 1 Results of tests

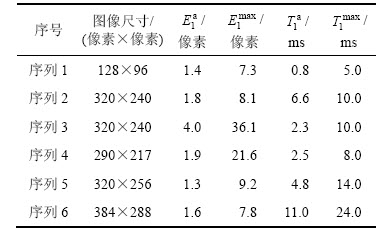

3.2 目标定位算法性能评估

通过以上实验分析,在“LBT”方法中,目标定位的性能起到关键的作用,接下来通过测试大量不同场景的图像序列对定位时间与精度进行评估。序列1至4的图像来源分别与实验1~4的来源相同,序列5的图像来自公共数据集“SPEVI”[20],序列6的图像来源是CAVIAR数据集[17]的ThreePastShop1cor视频。在原始图像序列中,挑选背景变化较大的图像重新组成测试图像序列,然后依次选择相邻2帧分别作为模板图像和观测图像进行测试,实验参数与3.1节的参数相同。通过匹配特征点计算出来的位置和真实目标位置的误差称为定位误差,对定位算法的评估指标分别为平均定位误差 、最大定位误差

、最大定位误差 、平均定位时间

、平均定位时间 和最长定位时间

和最长定位时间 。结果如表2所示。

。结果如表2所示。

表2 定位算法的统计数据

Table 2 Statistics data of target location

由于模板图像中特征点只分布在目标周围并且维持着一定的数量,“LBT”方法的定位时间并不完全与图像尺寸成正比,当观测图像特征点比较少并且与模板图像特征点相似度高的特征点数量少时,定位时间较短,如表2所示,序列2和序列3的图像尺寸一样,但序列3中背景颜色特征比较单一,检出的特征点也较少,因此,定位时间也较短。

从表2可以看出:定位算法的平均定位误差 和平均定位时间

和平均定位时间 都较小。平均定位时间最长的为序列6的11.0 ms;对于序列3和序列4,有几帧因为用于定位的特征点匹配错误导致定位误差较大,分别达到36.1个像素和21.6个像素。一共测试858帧,共有5帧由于特征点匹配错误而导致定位错误,错误率为0.58%。在有的序列中,原有的模板图像特征点范围找不到足够数量匹配的特征点,则通过不断扩大范围来增加匹配的特征点,相当于进行多次定位,从而导致定位时间延长,因此,最长定位时间比平均定位时间长很多,如序列5,平均定位时间为4.8 ms,而最长定位时间达到14.0 ms。

都较小。平均定位时间最长的为序列6的11.0 ms;对于序列3和序列4,有几帧因为用于定位的特征点匹配错误导致定位误差较大,分别达到36.1个像素和21.6个像素。一共测试858帧,共有5帧由于特征点匹配错误而导致定位错误,错误率为0.58%。在有的序列中,原有的模板图像特征点范围找不到足够数量匹配的特征点,则通过不断扩大范围来增加匹配的特征点,相当于进行多次定位,从而导致定位时间延长,因此,最长定位时间比平均定位时间长很多,如序列5,平均定位时间为4.8 ms,而最长定位时间达到14.0 ms。

综上所述,本文提出的基于局部背景特征定位的方法在各种场景下具有较高的定位精度以及实时性,除了与本文的改进的粒子滤波方法相结合外,还可以与现有的其他跟踪算法结合提高跟踪效果。

4 结论

1) 提出了一种基于局部背景特征点的目标定位和跟踪方法。该算法首先利用相邻2帧目标与周围特征点的位置关系对目标的位置进行初步定位,然后以该位置为起点,利用均值偏移的方法将粒子偏移到和目标相似度高的位置,根据粒子的分布得到多个候选目标区域,最后根据候选区域和定位位置的距离对候选目标的相似度进行加权,将加权后相似度最高的候选区域作为跟踪结果。实验结果表明,融合了局部背景特征点定位的跟踪方法能高效获得目标的大致位置,结合对候选区域加权的方法,不仅能提高跟踪效率,而且能避免相似区域的干扰。

2) 为了提高定位效率,模板图像中检测特征点的范围是动态变化的。当特征点数量较少时,可能会出现找不到匹配的特征点或者是用错误匹配的特征点进行定位的问题,导致跟踪失败或者是定位时间增长。在未来的研究中将研究更有效的特征点选择方法,从而使本方法适用于更多跟踪场合。

参考文献:

[1] CHIA Y S, KOW W Y, KHONG W L, et al. Kernel-based object tracking via particle filter and mean shift algorithm[C]// 11th International Conference on Hybrid Intelligent Systems (HIS). Melacca: IEEE, 2011: 522-527.

[2] COMANICIU D, RAMESH V, MEER P. Kernel-based object tracking[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25(5): 564-577.

[3] 张笑微, 周建雄, 师改梅, 等. 融合结构信息的粒子滤波均值偏移跟踪算法[J]. 计算机辅助设计与图形学学报, 2008, 20(12): 1583-1589.

Zhang Xiaowei, Zhou Jianxiong, SHI Gaimei, et al. Fusion of structural information in object tracking using particle filter and mean shift[J]. Journal of Computer-Aided Design & Computer Graphics, 2008, 20(12): 1583-1589.

[4] 侯志强, 黄安奇, 余旺盛, 等. 利用SIFT特征联合匹配的非刚体目标跟踪算法[J]. 系统工程与电子技术, 2015, 37(6): 1417-1423.

HOU Zhiqiang, HUANG Anqi, YU Wangsheng, et al. Non-rigid object tracking based on joint matching of SIFT features[J]. Systems Engineering and Electronics, 2015, 37(6): 1417-1423.

[5] 吴迪, 唐勇奇, 万琴. 基于视觉场景复杂度多特征自适应融合的目标跟踪[J]. 上海交通大学学报, 2015, 49(12): 1868-1875

WU Di, TANG Yongqi, WAN Qin. A novel adaptive fusion strategy based on tracking background complexity[J]. Journal of Shanghai Jiaotong University, 2015, 49(12): 1868-1875.

[6] NING Jifeng, ZHANG Lei, ZHANG David, et al. Robust mean-shift tracking with corrected background-weighted histogram[J]. The Institution of Engineering and Technology Computer Vision, 2012, 6(1): 62-69.

[7] 虞旦, 韦巍, 张远辉. 基于单目视觉的移动机器人跟随[J]. 仪器仪表学报, 2010, 31(3): 659-664.

YU Dan, WEI Wei, ZHANG Yuanhui. Person following of mobile robot using monocular camera[J]. Chinese Journal of Scientific Instrument, 2010, 31(3): 659-664.

[8] JUNG B, SUKHATME G S. Detecting moving objects using a single camera on a mobile robot in an outdoor environment[C]// 8th International Conference on Intelligent Autonomous Systems. Amsterdam, Netherlands: IEEE, 2004: 980-987.

[9] 江晓莲, 李翠华, 刘锴, 等. 基于视觉显著性的Wang-Landau蒙特卡罗采样突变目标跟踪算法[J]. 厦门大学学报(自然科学版), 2013, 52(4): 498-505.

JIANG Xiaolian, LI Cuihua, LIU Kai, et al. Abrupt motion tracking via saliency-based Wang-Landau Monte Carlo sampling[J]. Journal of Xiamen University(Natural Science), 2013, 52(4): 498-505.

[10] CERMAN L, MATAS J, HLAVA V. Sputnik tracker: having a companion improves robustness of the tracker[C]// 16th Scandinavian Conference on Image Analysis. Norway: Springer, 2009: 291-300.

[11] YANG Ming, WU Ying, HUA Gang. Context-aware visual tracking[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2009, 31(7): 1195-1209.

[12] GRABNER H, MATAS J, GOOL L V, et al. Tracking the invisible: learning where the object might be[C]// IEEE Conference on Computer Vision and Pattern Recognition (CVPR). San Francisco, CA, USA: IEEE, 2010: 1285-1292.

[13] DINH T B, VO N, MEDIONI G. Context tracker: exploring supporters and distracters in unconstrained environments[C]// IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Providence, USA: IEEE, 2011: 1177-1184.

[14] XIONG Zhen, ZHANG Yun. A novel interest-point-matching algorithm for high-resolution satellite images[J]. IEEE Transactions on Geoscience and Remote Sensing, 2009, 47(12): 4189-4200.

[15] 靳峰, 冯大政. 结合图像信息和几何关系的配准算法[J]. 华中科技大学学报(自然科学版), 2014, 42(2): 77-80.

JIN Feng, FENG Dazheng. Past precise registration algorithm combining image information and geometric relations[J]. Journal of Huazhong University of Science and Technology(Nature Science), 2014, 42(2): 77-80.

[16] ROSTEN E, PORTER R, DRUMMOND T. Machine learning for high-speed corner detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2006, 32(1): 105-119.

[17] CAVIAR. Context aware vision using image-based active recognition[EB/OL]. [2011-05-12]. http://groups.inf.ed.ac.uk /vision/CA VIAR/CAVIARDATA1.

[18] BIRCHFIELD S. Elliptical head tracking using intensity gradients and color histograms[C]// IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Santa Barbara, USA: IEEE, 1998: 232-237.

[19] KALAL Z, MIKOLAJCZYK K, MATAS J. Tracking- learning-detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2012, 34(7): 1409-1422.

[20] SPEVI. Surveillance performance evaluation initiative[EB/OL]. [2014-03-10]. http://www.eecs.qmul.ac.uk/~andrea/spe vi.html.

(编辑 刘锦伟)

收稿日期:2015-09-20;修回日期:2015-12-02

基金项目(Foundation item):广东省省部产学研项目(2012B090600028);广东省科技计划项目(2011A091101001,2012B010900076);广州市科技计划项目(2014Y2-00014)(Project(2012B090600028) supported by the Industry-University-Research Project of Guangdong Province and Ministry of Education; Projects(2011A091101001, 2012B010900076) supported by the Science and Technology Planning of Guangdong Province; Project(2014Y2-00014) supported by the Science and Technology Planning of Guangzhou)

通信作者:张铁,博士,教授,博士生导师,从事机器人、机器视觉和智能控制等研究;E-mail: merobot@scut.edu.cn